国芯+国模!DeepSeek适配国产芯片 AI算力底座迈向多样化.

近日,DeepSeek-V4预览版本上线并同步开源,包含DeepSeek-V4-Pro和DeepSeek-V4-Flash两个模型。

与此前主要基于英伟达CUDA框架而运行的模型不同,这次DeepSeek-V4将细粒度专家并行(EP)方案分别在英伟达GPU和华为昇腾NPU上完成了验证。预计今年下半年,随着昇腾950超节点批量上市,DeepSeek-V4 Pro的价格将大幅下调。

《科创板日报》记者获悉,目前华为昇腾超节点全系列产品已支持DeepSeek V4系列模型,实现DeepSeek V4-Pro20ms和DeepSeek V4-Flash 10ms低时延推理。此外,沐曦、寒武纪、摩尔线程、天数智芯、等国产芯片厂商也宣布支持DeepSeek-V4新模型。

值得一提的是,中国信息通信研究院联合人工智能软硬件协同创新与适配验证中心,宣布启动DeepSeek V4国产化适配测试工作。面向芯片、服务器、一体机、集群、开发框架及工具链、智算设施及平台等人工智能软硬件产品及系统开展。

多名业内专家对《科创板日报》记者表示,DeepSeek适配国产芯片,表明AI算力底座正朝多样化路径发展。目前国内互联网行业、云厂商等也在部署不同类型的AI算力,这意味着更多AI芯片厂商有机会扮演更为重要的角色。

AI算力底座朝多样化路径发展

沐曦股份携手FlagOS,已完成对DeepSeek最新开源的DeepSeek-V4-Flash模型的Day 0适配。沐曦股份还联合上海人工智能实验室KernelSwift智能算子迁移系统,率先完成DeepSeek-V4核心算子的Day 0适配。

沐曦股份联合创始人杨建对《科创板日报》记者表示,这次DeepSeek新模型发布,让国产GPU可以变成机器创造知识时代的生产力资料和生产力工具。目前不仅是Deepseek V4,Minimax2.7,阶跃星辰step3.5,kimi-2.6,智谱GLM5.1,mimo-V2等都可以基于国产GPU算力实现具有性价比的推理任务。

《科创板日报》记者获悉,由智源研究院牵头研发的众智FlagOS,目前已完成DeepSeek-V4-Flash在8款以上AI芯片上的全量适配与推理部署,包括海光、沐曦、华为昇腾、摩尔线程(FP8)、昆仑芯、平头哥真武、天数智芯等国产芯片。FlagOS同时正在推进DeepSeek-V4-Pro模型在多个芯片的迁移适配,后续即将开源。

IDC中国研究经理索引认为,DeepSeek全面适配昇腾芯片,表明AI算力底座正朝多样化路径发展,这一过程本身对AI产业发展具有推动作用,也是必然的发展趋势。

CIC灼识咨询董事总经理陈一心表示,DeepSeek的成功证明了基于国产算力同样能够运行世界级的大模型。此次适配昇腾950PR,是对国产高端芯片在复杂推理场景下性能的一次重要公开检验,将为后续更多模型和应用的迁移提供信心与范本。

陈一心称,大模型的繁荣高度依赖“硬件-软件-框架-应用”的完整生态。DeepSeek的适配行动,实质上是将庞大的开发者生态和模型应用生态向国产算力平台牵引。这有助于吸引更多开发者和企业基于昇腾平台进行创新,逐步打破对英伟达CUDA生态的单一依赖,推动中国“国产算力+国产大模型”闭环生态的成熟。

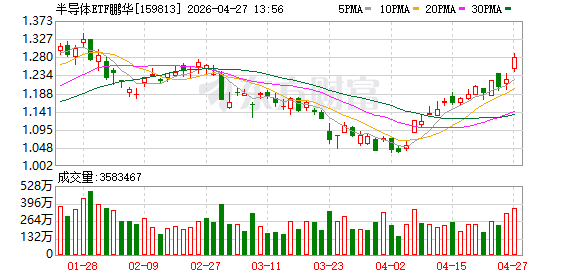

当前,券商机构对国产算力产业链的发展前景保持乐观。山西证券指出,DeepSeekV4等国产大模型有望原生适配国产算力,供需两旺下,国产芯片对国产通信芯片解决方案的需求更为迫切。随着更多国产GPU/ASIC标的登陆资本市场,国产算力芯片的供给能力正大幅增强,建议关注超节点交换芯片、IODchiplet、国产高速网卡三大算力通信方向。

中信证券研报指出,Agent&多模态等应用爆发驱动Token调用量井喷,进而导致国内算力荒,国产大模型在推理端积极适配为国产算力厂商带来加速放量机遇。其预计2026年国产算力芯片出货量至少实现翻倍以上增长,将为算力设计公司、先进制程、先进封装、先进存储以及配套产业链带来强劲增长动能。

国产算力成为AI云的支撑之一

随着DeepSeek-V4预览版上线,百度云、阿里云、华为云等国内主流厂商纷纷提供API服务。

百度智能云旗下百度千帆平台Day0适配提供API服务,通过百度千帆控制台或API即可直接调用DeepSeek-V4-Pro,DeepSeek-V4-Flash即将全量开放。阿里云百炼平台首发上线DeepSeek-V4-pro和DeepSeek-V4-flash两款模型,百炼Token Plan近期也将支持调用该模型。华为云MaaS模型即服务平台已为开发者提供免部署、一键调用DeepSeek-V4-FlashAPI的Tokens服务。

此外,国内AI云服务商PPIO也第一时间全量首批上线,成为业内最快上线DeepSeek-V4的AI云平台之一。

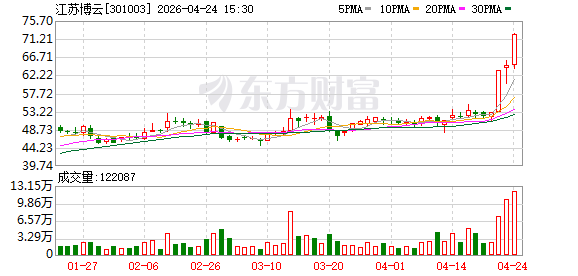

记者获悉,阿里、字节跳动等头部云厂商已开始部署相关国产算力。陈一心对《科创板日报》记者表示,推理侧国产算力已经比较成熟,训练侧快速追赶。头部云厂商从“试点”转向“大规模商用”,国产算力成为AI云的核心底座之一。

索引介绍,互联网行业从几年前就开始尝试部署不同类型的AI算力,已从过去较为单一的布局,转变成更为均衡的算力部署,不仅仅是芯片类型,在架构层面也在不断尝试,例如超节点/超集群产品的部署。这一趋势在未来几年预计保持,更加开放的架构也意味着更多AI芯片厂商有机会扮演更为重要的角色。

单位算力成本呈下降趋势 但总算力支出不会减少

新模型发布后,DeepSeek方面对API进行了降价。

DeepSeek全系列API服务,输入缓存命中的价格降至原有价格的1/10。Pro模型在2026年5月5日前还叠加2.5折限时优惠。此番降价叠加限时优惠后,DeepSeek-V4-Pro模型输入(缓存命中)降低至0.025元/百万Tokens,DeepSeek-V4-Flash输入(缓存命中)降低至0.02元/百万Tokens。。

DeepSeek此前还表示,受限于高端算力,目前V4-Pro模型的服务吞吐仍有限,预计下半年昇腾950超节点批量上市后,Pro价格会大幅下调。

陈一心认为,DeepSeek等模型通过算法创新本身就降低了60%的训练成本。而国产芯片厂商通过与DeepSeek的深度适配和联合优化,进一步提升了在特定芯片上的推理效率。这种“算法+硬件”的协同优化,直接压低了单次API调用的计算成本,为模型供应商降价提供了空间。

索引则表示,虽然单位算力的成本呈下降趋势,无论是本地部署还是从云上获取Token。但事实证明,算力成本的降低并不会减少算力支出,较低的单位成本正在扩大AI采用率以及工作负载规模,从而进一步增加算力基础设施的需求,形成由人工智能驱动的宏观经济良性循环。

(文章来源:财联社)

声明:

- 风险提示:以上内容仅来自互联网,文中内容或观点仅作为原作者或者原网站的观点,不代表本站的任何立场,不构成与本站相关的任何投资建议。在作出任何投资决定前,投资者应根据自身情况考虑投资产品相关的风险因素,并于需要时咨询专业投资顾问意见。本站竭力但不能证实上述内容的真实性、准确性和原创性,对此本站不做任何保证和承诺。

- 本站认真尊重知识产权及您的合法权益,如发现本站内容或相关标识侵犯了您的权益,请您与我们联系删除。

推荐文章: